MidJourney, l’une des startups de génération d’images AI les plus populaires, a annoncé mercredi le lancement de son modèle de génération de vidéos AI très attendu, V1.

V1 est un modèle d’image à vidéo, dans lequel les utilisateurs peuvent télécharger une image ou prendre une image générée par l’un des autres modèles de Midjourney et V1 produira un ensemble de vidéos de cinq secondes sur le four. Tout comme les modèles d’images de MidJourney, V1 n’est disponible que via Discord, et il n’est disponible que sur le Web au lancement.

Le lancement de V1 met MidJourney en concurrence avec des modèles de génération de vidéos AI provenant d’autres sociétés, telles que Sora d’Openai, Gen 4 de Runway, Adobe’s Firefly et Veo 3 de Google. Bien que de nombreuses sociétés se concentrent sur des modèles vidéo AI développés pour les types commerciaux dans les types commerciaux.

La société affirme qu’elle a des objectifs plus importants pour les modèles vidéo d’IA que de générer un roll B pour les films hollywoodiens ou commerciaux pour l’industrie de la publicité. Dans un article de blog, le PDG de MidJourney, David Holz, a déclaré que son modèle vidéo AI est la prochaine étape de l’entreprise vers sa destination ultime, créant des modèles d’IA «capables de simulations en temps ouvert en temps réel.

Après les modèles vidéo de l’IA, MidJourney dit qu’il prévoit de développer des modèles d’IA pour produire un rendu 3D, ainsi que des modèles d’IA en temps réel.

Le lancement du modèle V1 de Midjourney intervient une semaine après que la startup a été poursuivie par deux des studios les plus notoires d’Hollywood: Disney et Universal. Le costume allègue que les images créées par les modèles d’image AI de MidJourney représentent les personnages protégés par le droit d’auteur du studio, comme Homer Simpson et Dark Vador.

Les studios hollywoodiens ont été mis en confrontation pour faire face à la popularité croissante des modèles d’image et de gélification vidéo de l’IA, tels que ceux du développement de MidJourney. Il y a une crainte croissante que ces aold remplacent ou dévaluent le travail des créatifs dans leurs domaines respectifs, et plusieurs sociétés de médias ont allégué que les produits de thèse sont formés sur leurs œuvres protégées par le droit d’auteur.

Alors que MidJourney a essayé de se présenter comme différent des autres startups d’image et vidéo d’IA – plus axées sur la créativité que les applications commerciales immédiates – la startup ne peut pas échapper à ces accusations.

Pour commencer, MidJourney dit qu’il chargera 8 fois plus pour une génération de vidéos qu’une génération d’images typique, ce qui signifie que les abonnés seront à court de leurs générations mensuelles allouées beaucoup plus rapidement lors de la création de vidéos que d’images.

Au lancement, le moyen le moins cher d’essayer V1 est de sububiber le plan de base de 10 $ par mois de Midjourney. Les abonnés au plan professionnel de 60 $ par mois de MidJourney et au Mega Plan de 120 $ par mois auront des générations vidéo illimitées dans le mode Sweet, « Relax » de l’entreprise. Au cours du mois prochain, MidJourney dit qu’il rééditera ses prix pour les modèles vidéo.

V1 est livré avec quelques paramètres personnalisés qui permettent aux utilisateurs de contrôler les sorties du modèle vidéo.

Les utilisateurs peuvent sélectionner un paramètre d’animation automatique pour faire bouger une image au hasard, ou ils peuvent sélectionner un paramètre manuel qui permet aux utilisateurs de décrire, dans le texte, une animation spécifique qu’ils souhaitent ajouter à leur vidéo. Les utilisateurs peuvent également basculer le mouvement de la caméra et du sujet en sélectionnant «Low Motion» ou «High Motion» dans les paramètres.

Alors que les vidéos générées avec V1 ne durent que cinq secondes, les utilisateurs peuvent choisir de les prolonger en quelques secondes au four, ce qui signifie que les vidéos V1 pourraient devenir longs à 21 secondes.

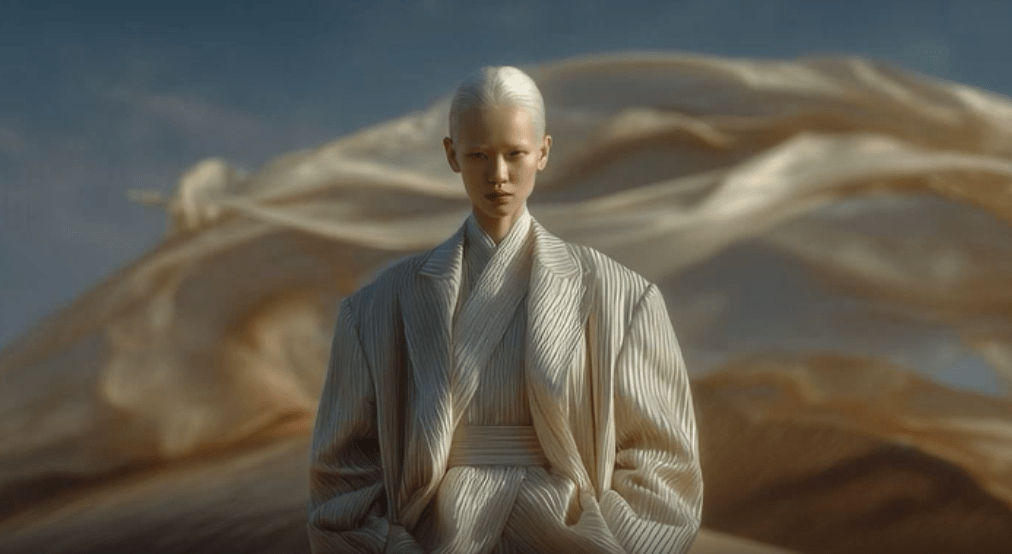

Tout comme les modèles d’image IA de MidJourney, les premières démos des vidéos de V1 semblent quelque peu d’un autre monde, plutôt qu’hyperréalistes. Le premier responsable de la V1 a été positif, bien qu’il ne soit pas encore clair à quel point il correspond à des modèles vidéo d’IA de premier plan, qui sont sur le marché depuis des mois, voire des années.