Le dernier cycle de financement de Starcloud valorise la société de calcul spatial à 1,1 milliard de dollars, ce qui en fait l’une des startups les plus rapides à atteindre le statut de licorne après avoir obtenu son diplôme de Y Combinator.

La série A de la société, clôturée 17 mois après sa présentation lors de la journée de démonstration, était dirigée par Benchmark et EQT Ventures. C’est un autre signe de l’intérêt porté à l’externalisation des centres de données en orbite alors que les obstacles liés aux ressources et aux politiques ralentissent leur développement sur Terre, mais le modèle économique dépend d’une technologie non éprouvée et d’importantes dépenses en capital.

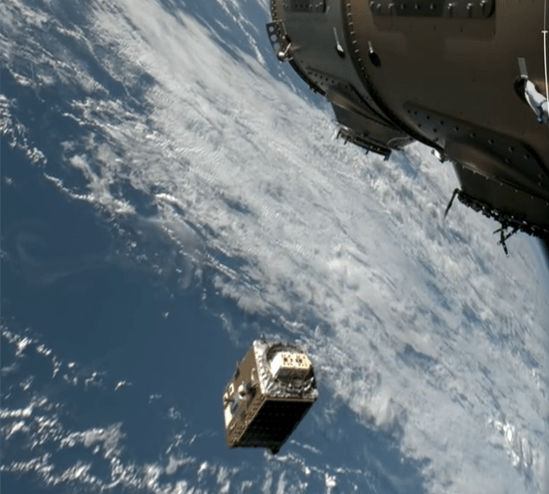

Starcloud a désormais levé un total de 200 millions de dollars et a lancé son premier satellite avec un GPU Nvidia H100 en novembre 2025. La société lancera une version plus puissante, Starcloud 2, plus tard cette année avec plusieurs GPU, dont une puce Nvidia Blackwell et un serveur lame AWS, ainsi qu’un ordinateur d’extraction de bitcoins.

La société commencera également à développer un vaisseau spatial de centre de données conçu pour être lancé depuis Starship, la fusée lourde réutilisable construite par SpaceX d’Elon Musk. Starcloud 3, comme son nom l’indique, sera un vaisseau spatial de 200 kilowatts et de trois tonnes qui s’adaptera au système « distributeur de pez » que SpaceX a conçu pour déployer ses satellites Starlink depuis Starship.

Le PDG et fondateur, Philip Johnston, a déclaré qu’il s’attend à ce qu’il s’agisse du premier centre de données orbital compétitif par rapport aux centres de données terrestres, avec des coûts de l’ordre de 0,05 $ par kW/heure d’énergie – si les coûts de lancement commercial atteignent environ 500 $ par kilogramme.

Le défi est que Starship ne vole pas encore ; Johnston dit qu’il s’attend à ce que l’accès commercial s’ouvre en 2028 et 2029. C’est la réalité à laquelle sont confrontés tous les grands projets de centres de données spatiaux : les ordinateurs spatiaux puissants seront d’un coût prohibitif jusqu’à ce qu’une nouvelle génération de fusées commence à être lancée à une cadence opérationnelle élevée, ce qui pourrait ne pas se produire avant les années 2030.

« Si cela finit par être retardé, nous continuerons simplement à lancer les versions plus petites sur Falcon 9 », a déclaré Johnston. « Nous ne serons pas compétitifs en termes de coûts énergétiques tant que Starship ne volera pas fréquemment. »

Événement Techcrunch

San Francisco, Californie

|

13-15 octobre 2026

« Il existe en quelque sorte deux modèles économiques », explique Johnston : l’un consiste à vendre de la puissance de traitement à d’autres engins spatiaux en orbite ; le premier satellite de l’entreprise, par exemple, analyse les données collectées par le vaisseau spatial radar de Capella Space. Ensuite, à l’avenir, lorsque les coûts de lancement diminueront, des centres de données distribués plus puissants pourraient potentiellement retirer du travail à leurs homologues terrestres.

Cela montre à quel point cette industrie est vraiment nouvelle. Lorsque le PDG de Nvidia, Jensen Huang, a dévoilé les modules de puces Vera Rubin Space-1 de la société lors de la conférence annuelle sur la technologie GPU de son entreprise la semaine dernière, il n’a pas noté qu’aucun n’avait été produit ou partagé avec les partenaires de développement de la société.

En fait, le nombre de GPU avancés en orbite se compte par dizaines, tandis que Nvidia aurait vendu près de 4 millions à des hyperscalers terrestres en 2025.

Ou considérez que le réseau de communication Starlink de SpaceX, le plus grand réseau de satellites en orbite avec 10 000 vaisseaux spatiaux, produit environ 200 mégawatts d’énergie, tandis que des centres de données d’une puissance de plus de 25 gigawatts sont actuellement en construction aux États-Unis, selon Cushman et Wakefield.

Johnston affirme que son entreprise est bien en avance sur la concurrence, avec le premier GPU terrestre déployé en orbite. Il a été utilisé pour entraîner un modèle d’IA en orbite, une première, selon Starcloud, et pour exécuter une version de Gemini. Au-delà des performances, Johnston affirme que Starcloud dispose désormais de données précieuses sur ce qu’il faut pour faire fonctionner une puce puissante dans l’espace.

« Pour être honnête, une H100 n’est probablement pas la meilleure puce pour l’espace, mais la raison pour laquelle nous l’avons fait est que nous voulions prouver que nous pouvions utiliser des puces terrestres de pointe dans l’espace », a-t-il déclaré à TechCrunch. Cette connaissance durement acquise – un autre GPU, un Nvidia A6000, est tombé en panne lors du lancement – influencera les conceptions futures.

Il existe une longue liste de défis techniques à résoudre, notamment la production d’énergie efficace et le refroidissement des puces fonctionnant à chaud. Starcloud-2 disposera du plus grand radiateur déployable piloté sur un satellite privé ; il s’attend à ce qu’au moins deux versions supplémentaires de ce vaisseau spatial se mettent en orbite, a déclaré Johnston.

Reste ensuite le défi de la synchronisation. Les charges de travail les plus importantes des centres de données, souvent destinées à la formation, nécessitent que des centaines, voire des milliers de GPU fonctionnent en tandem. Faire cela dans l’espace nécessitera soit un vaisseau spatial fantastiquement grand, soit des liaisons laser puissantes et fiables entre les vaisseaux spatiaux volant en formation. La plupart des entreprises travaillant sur cette technologie s’attendent à ce que ces charges de travail surviennent bien après que des tâches d’inférence plus simples aient eu lieu en orbite.

Outre Starcloud, Aetherflux, le projet Suncatcher de Google et Aethero – qui a lancé le premier GPU Jetson spatial de Nvidia en 2025 – développent tous des activités de centres de données spatiaux.

L’éléphant dans la pièce est SpaceX lui-même, qui a demandé au gouvernement américain l’autorisation de construire et d’exploiter un million de satellites pour l’informatique distribuée dans l’espace.

Affronter SpaceX est une tâche ardue pour tout entrepreneur, mais Johnston voit de la place pour la coexistence.

« Ils construisent pour un cas d’utilisation légèrement différent du nôtre », a-t-il déclaré à TechCrunch. « Ils prévoient principalement de servir les charges de travail de Grok et Tesla. Il se peut qu’à un moment donné, ils proposent un service cloud tiers, mais je pense qu’il est peu probable qu’ils le fassent, c’est ce que nous faisons (en tant que) acteur de l’énergie et des infrastructures. «