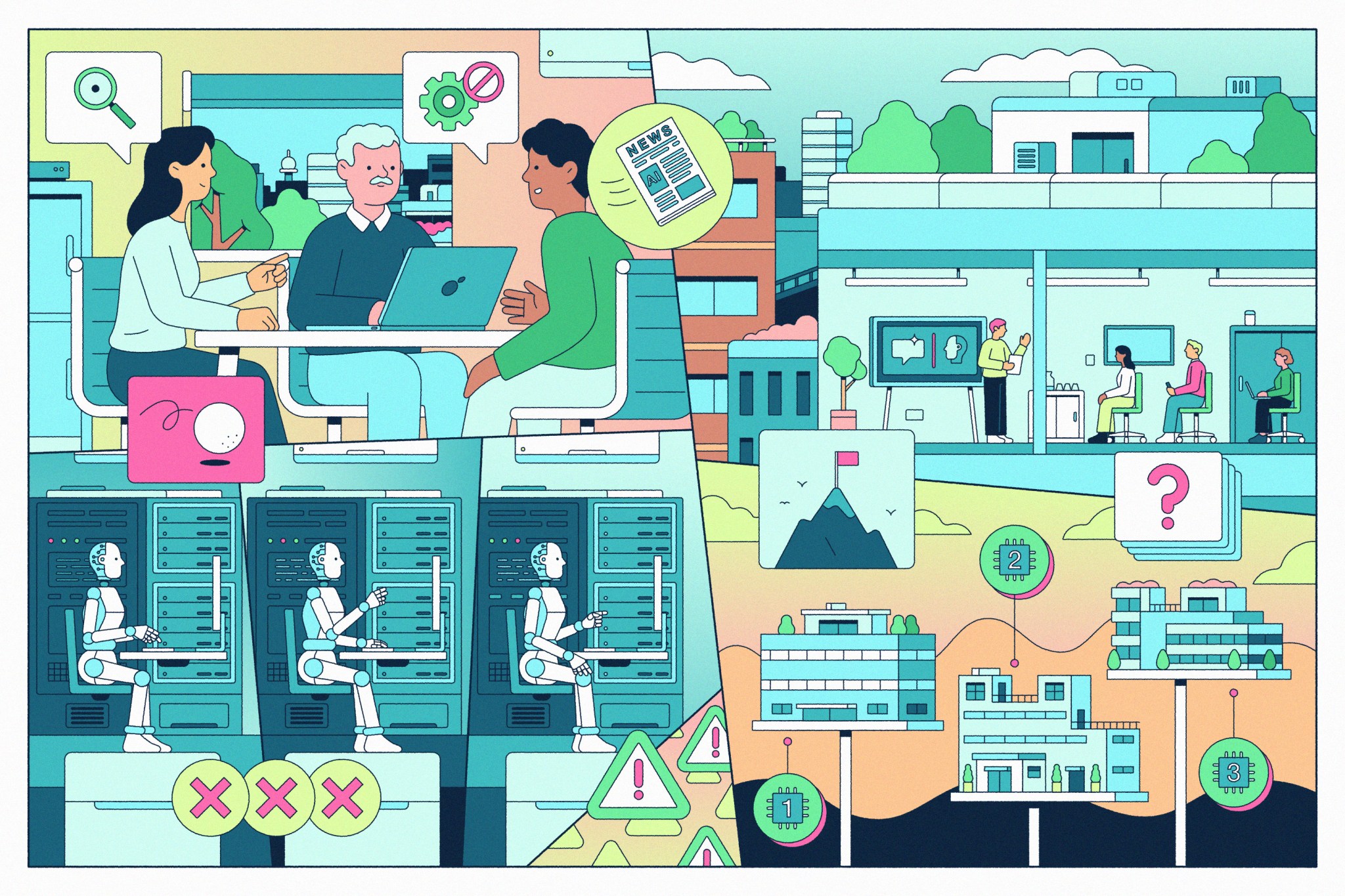

L’agent AI est sur la scène centrale du monde de l’IA, de la technologie et des entreprises, dominant le discours et la pression de l’entreprise pour intégrer rapidement la technologie et prendre du retard sur leurs concurrents. Plus que quiconque, la personne accusée de résoudre les promesses et la réalité des derniers mots à la mode de l’IA est le principal officier de l’IA (CAIO).

Superviser les expériences et le déploiement d’agents de l’IA et diriger d’autres dirigeants dans leur voyage, CAIO navigue sur le battage médiatique, la sécurité et les préoccupations de confiance, et les interconnexions (ou le manque de) ces systèmes. Inutile de dire que vous devez répondre à la question: qu’est-ce qu’un agent d’IA?

L’hypothèse permettra aux entreprises de perdre la focalisation

Comme Fortune et d’autres l’ont rapporté, personne ne peut être d’accord avec ce que le terme « agent d’IA » signifie vraiment. Les entreprises définissent ce terme différemment et l’utilisent souvent pour décrire une variété de fonctionnalités et de fonctionnalités. Cela comprend de nombreux décrits précédemment dans d’autres termes tels que «AI ASSISTANT». Le directeur en chef d’Accenture, Lan Guan, dirige la construction d’une solution d’agent d’IA appelé Rafinery IA pour les clients, et alors qu’il travaille directement dans le déploiement de ses propres agents d’IA et d’IA, il a passé beaucoup de temps à aider les clients à régler les incohérences.

« Il y a un an, tout le monde a dit: » J’ai besoin de faire de la génération. » Maintenant, tout le monde dit: « Nous devons être un agent AI ou un agent de l’IA. » Et à la fin de la journée, il semble que beaucoup d’entre eux soient toujours appelés la même chose « , a-t-elle déclaré. « Donc, le client est: » Qu’est-ce qu’un agent d’IA? Que déploie-t-il? » Et nous passons beaucoup de temps à éduquer. »

L’effet en fuite est qu’il a rapidement renversé les soi-disant agents de l’IA « juste pour les communiqués de presse », explique Michelle Bonat, chef de l’IA à l’IA Squared. La pression pour obtenir une réponse aux moments de l’IA de l’agent permet à certaines entreprises de renommer les fonctionnalités ou de chasser les agents de l’IA de continuer à tendance.

« Je le regarde parfaitement. Je le vois tous les jours », explique Bonat. « C’est pourquoi cet espace est plein de bruit. »

La sécurité, les erreurs et la confiance régissent l’analyse des risques

Malgré le battage médiatique et la terminologie déroutante, les idées de base des agents de l’IA (systèmes conçus pour agir pour effectuer certaines tâches) créent toujours une excitation légitime. C’est également la clé pour créer le type de systèmes que les ingénieurs de systèmes et les amateurs de science-fiction ont toujours rêvé, ce qui nous permet d’effectuer des séquences complexes de tâches sur plusieurs plates-formes en notre nom. Cependant, il y a des obstacles réels.

Uli Yalsharmi, co-fondateur et chef de l’IA, directeur de l’IA chez Fetchel, qui utilise l’IA pour les prix prédictifs pour l’industrie aéronautique, estime que les opportunités concernant les agents de l’IA sont « énormes », mais le déverrouillage de cette valeur repose sur la résolution des défis réels concernant la confiance et l’intégration et d’éviter les points d’échec. Par exemple, les agents doivent s’intégrer aux systèmes hérités et faire correspondre les contraintes réelles sans perturber les workflows existants. Et il a dit que, alors que nous donnons aux agents plus d’autonomie, nous devons construire des garde-corps, une surveillance, des systèmes de remplacement et des mécanismes d’alignement humain.

« Les entreprises doivent faire confiance aux décisions des agents », a-t-il ajouté. « Cela nécessite la transparence, la cohérence et le retour sur investissement démontrable. »

L’un des obstacles les plus préoccupants est la combinaison d’erreurs. Le PDG de Google Deepmind Demis Hassabis compare le problème avec l’intérêt composé sur les finances, expliquant que même si le modèle d’agent n’a que 1% d’erreur, une réaction en chaîne des erreurs peut se produire après des milliers d’étapes, et finalement le résultat correct peut être complètement « aléatoire ». Bonat souligne le problème de la création d’erreurs encore plus compliquée comme un défi sérieux en termes de confiance des agents de l’IA, et dit que même les êtres humains n’en sont pas conscients peuvent exacerber un faux pas, ce qui signifie qu’il ne crée même pas de « crash ».

Cela est particulièrement vrai pour un type de système multi-agents auxquels de nombreuses entreprises pensent. Guan a déclaré que cela pourrait causer des angles morts et vous causer des ennuis très rapidement.

« Cela peut ne pas fonctionner pour vous, et cela peut en fait poser beaucoup de risques », a-t-elle déclaré. « Pensez-y. Beaucoup de workflows et de transactions et interactions commerciaux sont des intérêts élevés. Ils ne veulent pas que les agents fassent des remboursements à tous les clients, non? » Elle a ajouté que même si ses clients ont un fort appétit pour voir l’impact des agents de l’IA, ils se méfient également de surprenants bâtiments de cloud élevés et des risques de sécurité.

Les problèmes de sécurité sont certainement sincères dans le paysage de l’agent d’IA. D’ici 2028, Gartner prédit que 25% des violations des entreprises remontent aux agents de l’IA qui incluent les abus des acteurs malveillants internes et externes. Le facteur dominant contribuant au risque de sécurité est la combinaison de l’autonomie et l’interopérabilité prévue des systèmes d’agent, la connexion aux systèmes d’agent, l’échange de données, agissant de manière autonome et agissant sur un large éventail de plates-formes et de systèmes. En mettant différemment, la nature exacte de la façon dont ces systèmes fonctionnent et de ce qu’ils ont l’intention de faire est de les mettre à grand risque.

Les rêves d’interopérabilité ont du mal à être libérés d’un jardin clos

Comme tous les Caios, Ali Alkhafaji, chef de l’IA et chef de la technologie du Omnicom Precision Marketing Group, est préoccupé par les fuites de données et d’autres risques de sécurité. Il craint également que de nombreuses entreprises commercialisent les systèmes d’agents utilisent la sécurité comme une excuse pratique pour que les clients puissent se verrouiller davantage dans l’écosystème.

« Tous les fournisseurs construisent leurs propres« cadres d’agent », mais personne ne résout l’interopérabilité au niveau de l’entreprise. Sans un cadre ouvert et des normes sémantiques, nous construisons simplement des silos plus intelligents », a-t-il déclaré.

Le chef américain d’Ai Jim Rowan, Deloitte, a vu cette pièce parmi ses clients. Il s’agit d’une autre itération des avantages des plates-formes qui stimulent la croissance de fournisseurs comme OpenAI, Google et Microsoft, car les clients actuels sont installés dans de nouveaux pipelines et produits d’IA.

« Il y a une tension claire sur le marché entre les personnes qui souhaitent posséder un système d’agent pour les enregistrements. C’est comme quelqu’un qui possède un registre qui coordonne toute l’orchestration qui se passe autour de l’agent », a déclaré Rowan. « C’est vrai pour les hyperscalers et les fournisseurs SaaS et les startups tierces de l’espace. Je ne pense pas que les juges soient sortis des personnes qui en possèdent encore. »

Fix, 3 septembre 2025: les versions précédentes de cette histoire ont mal compris le nom de la solution d’agent AI d’Accenture.