Les crues soudaines comptent parmi les événements météorologiques les plus meurtriers au monde, tuant plus de 5 000 personnes chaque année. Ils sont également parmi les plus difficiles à prévoir. Mais Google pense avoir résolu ce problème d’une manière improbable : en lisant l’actualité.

Bien que les humains aient rassemblé de nombreuses données météorologiques, les crues soudaines sont trop éphémères et localisées pour être mesurées de manière exhaustive, comme la température ou même le débit des rivières sont surveillés au fil du temps. Ce manque de données signifie que les modèles d’apprentissage profond, de plus en plus capables de prévoir la météo, ne sont pas en mesure de prédire les crues soudaines.

Pour résoudre ce problème, les chercheurs de Google ont utilisé Gemini – le grand modèle linguistique de Google – pour trier 5 millions d’articles de presse du monde entier, isolant les rapports de 2,6 millions d’inondations différentes et transformant ces rapports en une série temporelle géolocalisée baptisée « Groundsource ». C’est la première fois que l’entreprise utilise des modèles linguistiques pour ce type de travail, selon Gila Loike, chef de produit Google Research. La recherche et l’ensemble des données ont été partagés publiquement jeudi matin.

Avec Groundsource comme référence réelle, les chercheurs ont formé un modèle construit sur un réseau neuronal LSTM (Long Short-Term Memory) pour ingérer les prévisions météorologiques mondiales et générer la probabilité d’inondations soudaines dans une zone donnée.

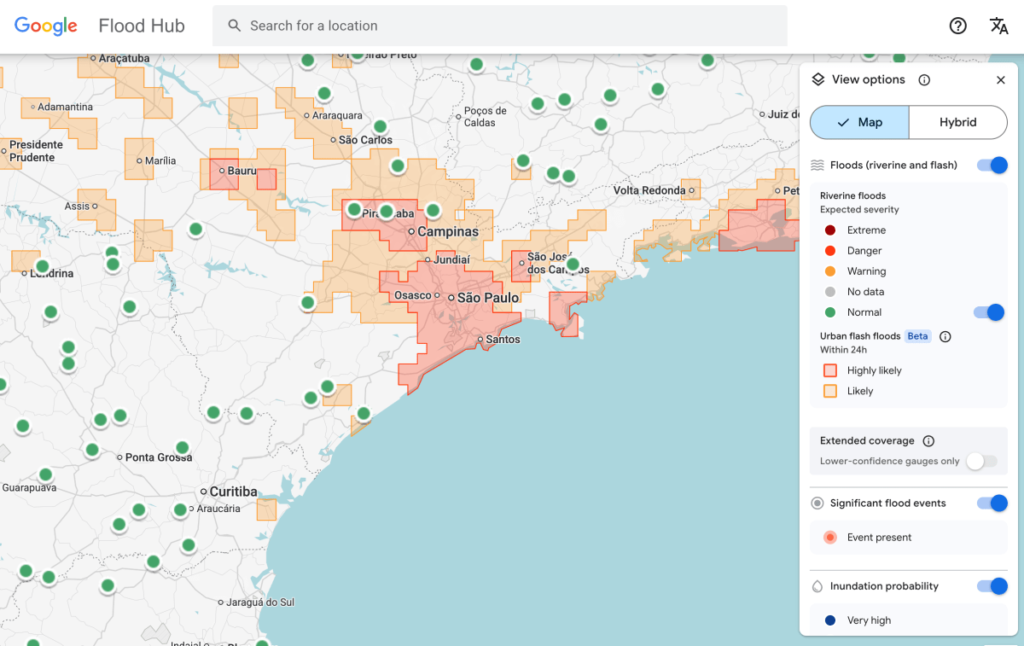

Le modèle de prévision des crues éclair de Google met désormais en évidence les risques pour les zones urbaines de 150 pays sur la plateforme Flood Hub de l’entreprise et partage ses données avec les agences d’intervention d’urgence du monde entier. António José Beleza, responsable des interventions d’urgence à la Communauté de développement de l’Afrique australe qui a testé le modèle de prévision avec Google, a déclaré que cela avait aidé son organisation à réagir plus rapidement aux inondations.

Il existe encore des limites au modèle. D’une part, sa résolution est assez faible, permettant d’identifier les risques sur des zones de 20 kilomètres carrés. Et il n’est pas aussi précis que le système d’alerte aux inondations du National Weather Service des États-Unis, en partie parce que le modèle de Google n’intègre pas les données radar locales, qui permettent un suivi en temps réel des précipitations.

Une partie du problème, cependant, est que le projet a été conçu pour fonctionner dans des endroits où les gouvernements locaux ne peuvent pas se permettre d’investir dans des infrastructures coûteuses de détection météorologique ou ne disposent pas d’enregistrements complets de données météorologiques.

Événement Techcrunch

San Francisco, Californie

|

13-15 octobre 2026

« Parce que nous regroupons des millions de rapports, l’ensemble de données Groundsource aide en fait à rééquilibrer la carte », a déclaré cette semaine Juliet Rothenberg, responsable de programme au sein de l’équipe Resilience de Google. « Cela nous permet d’extrapoler à d’autres régions où il n’y a pas autant d’informations. »

Rothenberg a déclaré que l’équipe espère que l’utilisation des LLM pour développer des ensembles de données quantitatives à partir de sources écrites et qualitatives pourrait être appliquée aux efforts visant à créer des ensembles de données sur d’autres phénomènes éphémères mais importants à prévoir, comme les vagues de chaleur et les coulées de boue.

Marshall Moutenot, PDG d’Upstream Tech, une société qui utilise des modèles d’apprentissage profond similaires pour prévoir les débits des rivières pour des clients comme les sociétés hydroélectriques, a déclaré que la contribution de Google fait partie d’un effort croissant visant à rassembler des données pour des modèles de prévision météorologique basés sur l’apprentissage profond. Moutenot a cofondé Dynamical.org, un groupe qui organise une collection de données météorologiques prêtes pour l’apprentissage automatique pour les chercheurs et les startups.

« La rareté des données est l’un des défis les plus difficiles en géophysique », a déclaré Moutenot. « Simultanément, il y a trop de données terrestres, et quand vous voulez évaluer la vérité, il n’y en a pas assez. C’était une approche vraiment créative pour obtenir ces données. »