L’administration Trump a présenté vendredi un cadre législatif pour une politique unique en matière d’IA aux États-Unis. Ce cadre centraliserait le pouvoir à Washington en anticipant les lois des États sur l’IA, ce qui pourrait potentiellement saper les efforts récents des États pour réglementer l’utilisation et le développement de la technologie.

« Ce cadre ne peut réussir que s’il est appliqué uniformément à travers les États-Unis », peut-on lire dans une déclaration de la Maison Blanche à ce sujet. « Une mosaïque de lois nationales contradictoires nuirait à l’innovation américaine et à notre capacité à prendre la tête de la course mondiale à l’IA. »

Le cadre décrit sept objectifs clés qui donnent la priorité à l’innovation et à la mise à l’échelle de l’IA, et propose une approche fédérale centralisée qui outrepasserait les réglementations plus strictes au niveau des États. Il confère une responsabilité importante aux parents sur des questions telles que la sécurité des enfants et définit des attentes relativement souples et non contraignantes en matière de responsabilité de la plateforme.

Par exemple, il affirme que le Congrès devrait exiger des sociétés d’IA qu’elles mettent en œuvre des fonctionnalités qui « réduisent les risques d’exploitation sexuelle et de préjudice envers les mineurs », mais n’énonce aucune exigence claire et exécutoire.

Le cadre de Trump intervient trois mois après qu’il a signé un décret ordonnant aux agences fédérales de contester les lois des États sur l’IA. L’ordonnance donnait au ministère du Commerce 90 jours pour dresser une liste des lois étatiques « onéreuses » sur l’IA, risquant potentiellement l’éligibilité des États aux fonds fédéraux comme les subventions au haut débit. L’agence n’a pas encore publié cette liste.

L’ordonnance ordonnait également à l’administration de travailler avec le Congrès sur une loi uniforme sur l’IA. Cette vision se précise et reflète la stratégie antérieure de Trump en matière d’IA, qui se concentrait moins sur les garde-fous que sur la promotion de la croissance des entreprises.

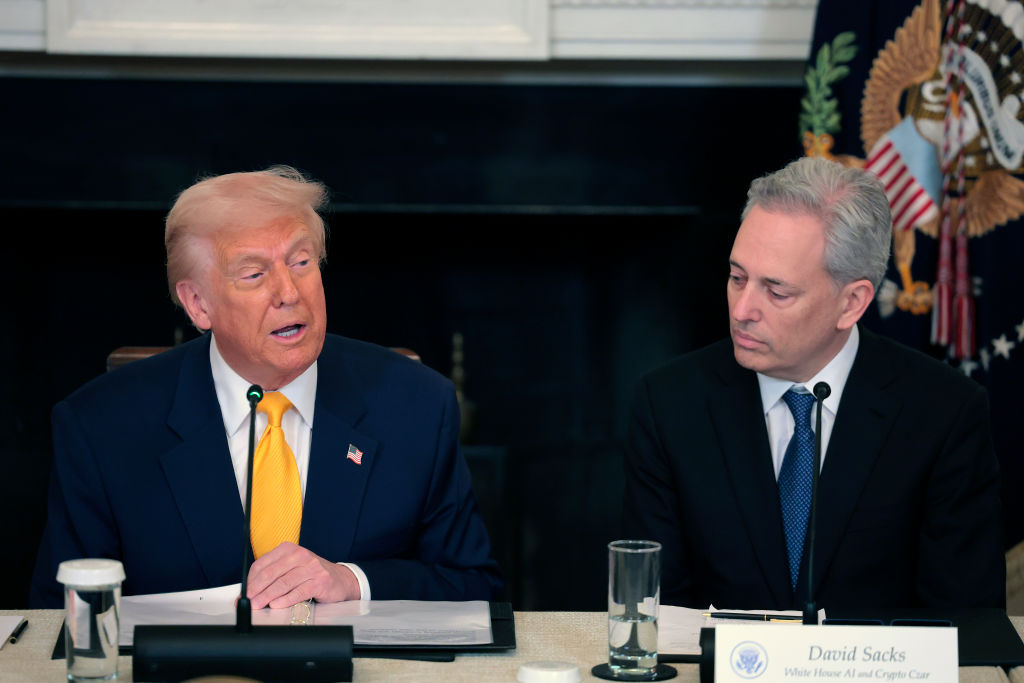

Le nouveau cadre propose une « norme nationale peu contraignante », faisant écho à la volonté plus large de l’administration de « supprimer les obstacles obsolètes ou inutiles à l’innovation » et d’accélérer l’adoption de l’IA dans tous les secteurs. Il s’agit d’une approche réglementaire légère et favorable à la croissance, défendue par les « accélérateurs », parmi lesquels le tsar de l’IA à la Maison Blanche et investisseur en capital-risque David Sacks.

Événement Techcrunch

San Francisco, Californie

|

13-15 octobre 2026

Bien que le cadre fasse un clin d’œil au fédéralisme, les exclusions pour les États sont relativement étroites, ne préservant que leur autorité sur les lois générales telles que la fraude et la protection de l’enfance, le zonage et l’utilisation de l’IA par l’État. Il établit une ligne dure contre les États qui réglementent le développement de l’IA lui-même, ce qui, selon lui, est une question « intrinsèquement interétatique » liée à la sécurité nationale et à la politique étrangère.

Le cadre vise également à empêcher les États de « pénaliser les développeurs d’IA pour le comportement illégal d’un tiers impliquant leurs modèles » – une protection essentielle en matière de responsabilité pour les développeurs.

Il manque dans ce cadre tout geste en faveur de cadres de responsabilité, de surveillance indépendante ou de mécanismes d’application des nouveaux préjudices potentiels causés par l’IA. En effet, ce cadre centraliserait l’élaboration des politiques en matière d’IA à Washington tout en réduisant la marge de manœuvre des États pour agir en tant que premiers régulateurs des risques émergents.

Les critiques affirment que les États sont les bacs à sable de la démocratie et qu’ils ont été plus rapides à adopter des lois sur les risques émergents. Notamment, la RAISE Act de New York et le SB-53 de Californie visent à garantir que les grandes entreprises d’IA disposent et respectent des protocoles de sécurité documentés publiquement.

« David Sacks, le tsar de l’IA à la Maison Blanche, continue de répondre aux attentes des grandes technologies aux dépens des Américains ordinaires et travailleurs », a déclaré Brendan Steinhauser, PDG de l’Alliance for Secure AI. « Ce cadre fédéral en matière d’IA vise à empêcher les États de légiférer sur l’IA et n’offre aucune voie permettant aux développeurs d’IA de rendre des comptes pour les dommages causés par leurs produits. »

De nombreux acteurs de l’industrie de l’IA célèbrent cette orientation car elle leur donne de plus grandes libertés pour « innover » sans la menace d’une réglementation.

« Ce cadre est exactement ce que les startups demandaient : une norme nationale claire leur permettant de construire rapidement et à grande échelle », a déclaré Teresa Carlson, présidente du General Catalyst Institute, à TechCrunch. « Les fondateurs ne devraient pas avoir à se retrouver confrontés à une mosaïque de lois nationales contradictoires sur l’IA qui entravent l’innovation. »

Sécurité des enfants, droits d’auteur et liberté d’expression

Le cadre a été publié à un moment où la sécurité des enfants est devenue un point central du débat sur l’IA. Certains États ont pris des mesures agressives pour adopter des lois visant à protéger les mineurs et à responsabiliser davantage les entreprises technologiques. La proposition de l’administration va dans une direction différente, en mettant davantage l’accent sur le contrôle parental que sur la responsabilité de la plateforme.

« Les parents sont les mieux équipés pour gérer l’environnement numérique et l’éducation de leurs enfants », indique le cadre. « L’administration appelle le Congrès à donner aux parents des outils pour y parvenir efficacement, tels que des contrôles de compte pour protéger la vie privée de leurs enfants et gérer l’utilisation de leurs appareils. »

Le cadre indique également que l’administration « estime » que les plateformes d’IA devraient « mettre en œuvre des fonctionnalités visant à réduire l’exploitation sexuelle potentielle des enfants et à encourager l’automutilation ». Bien qu’elle appelle le Congrès à exiger de telles garanties et affirme que les lois existantes, y compris celles interdisant les matériels pédopornographiques, devraient s’appliquer aux systèmes d’IA, la proposition emploie des qualificatifs tels que « commercialement raisonnable » et ne définit pas de conditions préalables claires.

En ce qui concerne le droit d’auteur, le cadre tente de trouver un juste milieu entre la protection des créateurs et la possibilité de former des systèmes d’IA sur des œuvres existantes, en citant la nécessité d’une « utilisation équitable ». Ce type de langage reflète les arguments avancés par les entreprises d’IA alors qu’elles font face à un nombre croissant de poursuites en matière de droits d’auteur concernant leurs données de formation.

Les principaux garde-fous que le cadre d’IA de Trump semble souligner consistent à garantir que « l’IA puisse rechercher la vérité et l’exactitude sans limitation ». Plus précisément, il se concentre sur la prévention de la censure imposée par le gouvernement, plutôt que sur la modération de la plateforme elle-même.

« Le Congrès devrait empêcher le gouvernement des États-Unis de contraindre les fournisseurs de technologie, y compris les fournisseurs d’IA, à interdire, contraindre ou modifier des contenus sur la base d’agendas partisans ou idéologiques », indique le cadre. Il demande également au Congrès de fournir aux Américains un moyen d’intenter une action en justice contre les agences gouvernementales qui cherchent à censurer l’expression sur les plateformes d’IA ou à dicter les informations fournies par une plateforme d’IA.

Ce cadre intervient alors qu’Anthropic poursuit le gouvernement pour avoir prétendument violé ses droits du premier amendement après que le ministère de la Défense (DOD) l’a qualifié de risque pour la chaîne d’approvisionnement. Anthropic affirme que le DOD le désigne comme tel en représailles au fait de ne pas autoriser l’armée à utiliser ses produits d’IA pour la surveillance de masse des Américains ou pour prendre des décisions de ciblage et de tir avec des armes mortelles autonomes. Trump a qualifié Anthropic et son PDG Dario Amodei de « éveillés » et de « gauchistes radicaux ».

Le langage du cadre, qui met l’accent sur la protection de « l’expression ou la dissidence politique licite », semble s’appuyer sur le précédent décret de Trump ciblant « l’IA réveillée », qui a poussé les agences fédérales à adopter des systèmes jugés idéologiquement neutres.

On ne sait pas exactement ce qui constitue une censure par rapport à une modération standard du contenu. Un tel langage pourrait donc rendre difficile la coordination des régulateurs avec les plateformes sur des questions telles que la désinformation, l’ingérence électorale ou les risques pour la sécurité publique.

Samir Jain, vice-président des politiques au Centre pour la démocratie et la technologie, a souligné : « (Le cadre) dit à juste titre que le gouvernement ne devrait pas contraindre les sociétés d’IA à interdire ou à modifier le contenu sur la base de « programmes partisans ou idéologiques », et pourtant, le décret de l’administration sur « l’IA réveillée » cet été fait exactement cela.