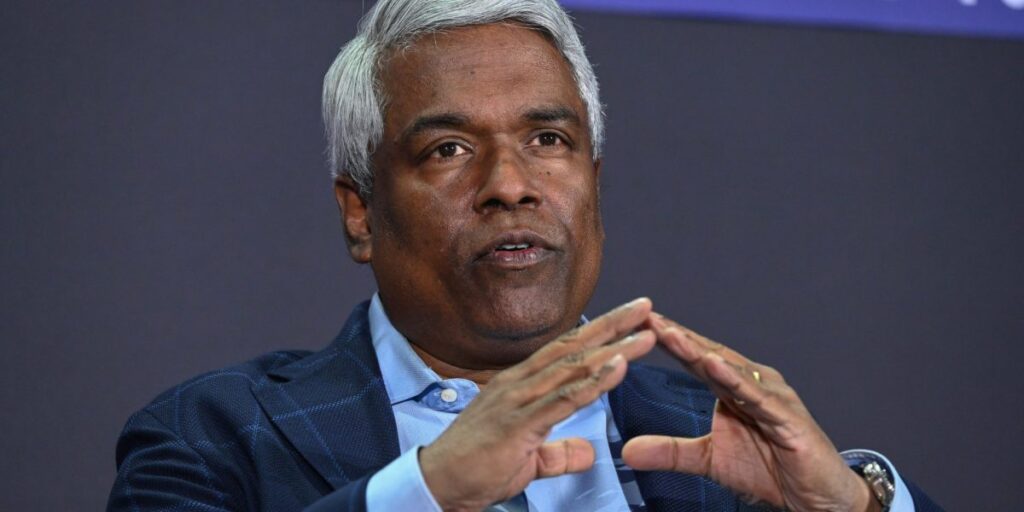

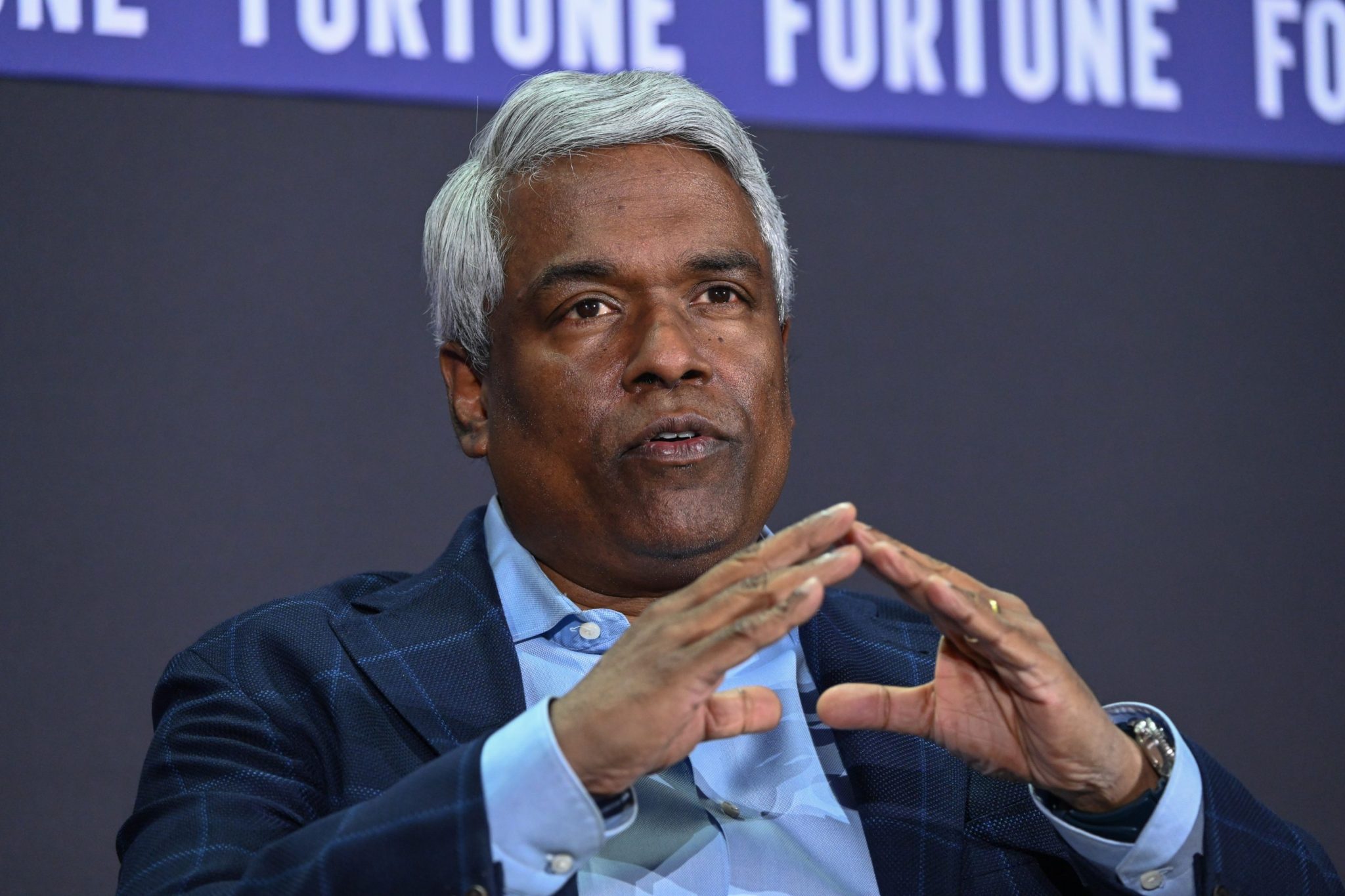

Thomas Kurian, PDG de Google Cloud, a déclaré que l’énorme quantité d’énergie requise pour le calcul de l’IA avait été identifiée très tôt comme un goulot d’étranglement, ce qui a incité Google Cloud d’Alphabet à planifier la manière dont il se procurerait et utiliserait l’énergie.

S’exprimant lors de l’événement Fortune Brainstorming AI à San Francisco lundi, il a noté que la société, un moteur majeur dans le paysage des infrastructures d’IA, travaillait sur l’IA bien avant les modèles linguistiques à grande échelle et adoptait une vision à long terme.

« Nous savions également que l’énergie serait le plus gros problème à l’avenir, car l’énergie et les centres de données seraient le goulot d’étranglement avec les puces », a déclaré Kurian à Andrew Nsukka de Fortune. « Nous avons donc conçu la machine pour qu’elle soit extrêmement efficace. »

L’Agence internationale de l’énergie estime que certains centres de données centrés sur l’IA peuvent consommer l’équivalent de 100 000 foyers, et que les plus grandes installations en construction pourraient en utiliser jusqu’à 20 fois cette quantité.

Dans le même temps, la capacité mondiale des centres de données augmentera de 46 % au cours des deux prochaines années, ce qui équivaut à une augmentation de près de 21 000 mégawatts, selon le cabinet de conseil immobilier Knight Frank.

Lors de l’événement Brainstorm, Kurian a expliqué l’approche en trois volets de Google Cloud pour garantir qu’il y a suffisamment d’énergie pour répondre à toutes vos demandes.

Premièrement, l’entreprise vise à diversifier autant que possible les types d’énergie qui alimentent ses calculs d’IA. Il dit que même si beaucoup de gens affirment que toute forme d’énergie peut être exploitée, ce n’est pas réellement le cas.

« Si vous exécutez un cluster pour la formation, que vous démarrez le cluster et que vous commencez à exécuter des tâches de formation, ce pic de calcul consomme tellement d’énergie que certaines formes de production d’énergie ne peuvent pas le gérer », a expliqué Kurian.

Le deuxième volet de la stratégie de Google Cloud consiste à être aussi efficace que possible, notamment en réutilisant l’énergie au sein de ses centres de données, a-t-il ajouté.

En effet, l’entreprise utilise l’IA dans ses systèmes de contrôle pour surveiller les échanges thermodynamiques nécessaires à l’exploitation de l’énergie déjà déployée dans le centre de données.

Et troisièmement, Google Cloud travaille sur « de nouvelles technologies fondamentales pour produire de l’énergie de nouvelles manières », a déclaré Kurian, sans plus de détails.

Plus tôt lundi, la société de services publics NextEra Energy et Google Cloud ont annoncé qu’ils étendraient leur partenariat pour développer un nouveau campus de centres de données aux États-Unis qui comprendrait également une nouvelle centrale électrique.

Les leaders technologiques ont averti que, parallèlement à l’innovation en matière de puces et à l’amélioration des modèles linguistiques, l’approvisionnement en énergie est essentiel au développement de l’IA.

La capacité de construire des centres de données constitue un autre défi potentiel. Le PDG de Nvidia, Jensen Huang, a récemment souligné l’avantage de la Chine par rapport aux États-Unis à cet égard.

« Si vous souhaitez construire un centre de données ici aux États-Unis, il faudra probablement environ trois ans entre le début des travaux et le démarrage d’un supercalculateur d’IA », a-t-il déclaré au Centre d’études stratégiques et internationales fin novembre. « Ils peuvent construire un hôpital en un week-end. »