Alors que la rupture de Washington avec Anthropic a révélé l’absence totale de règles cohérentes régissant l’intelligence artificielle, une coalition bipartite de penseurs a rassemblé quelque chose que le gouvernement a jusqu’à présent refusé de produire : un cadre sur ce à quoi devrait réellement ressembler le développement responsable de l’IA.

La Déclaration pro-humaine a été finalisée avant l’affrontement Pentagone-Anthropique de la semaine dernière, mais la collision des deux événements n’a échappé à personne.

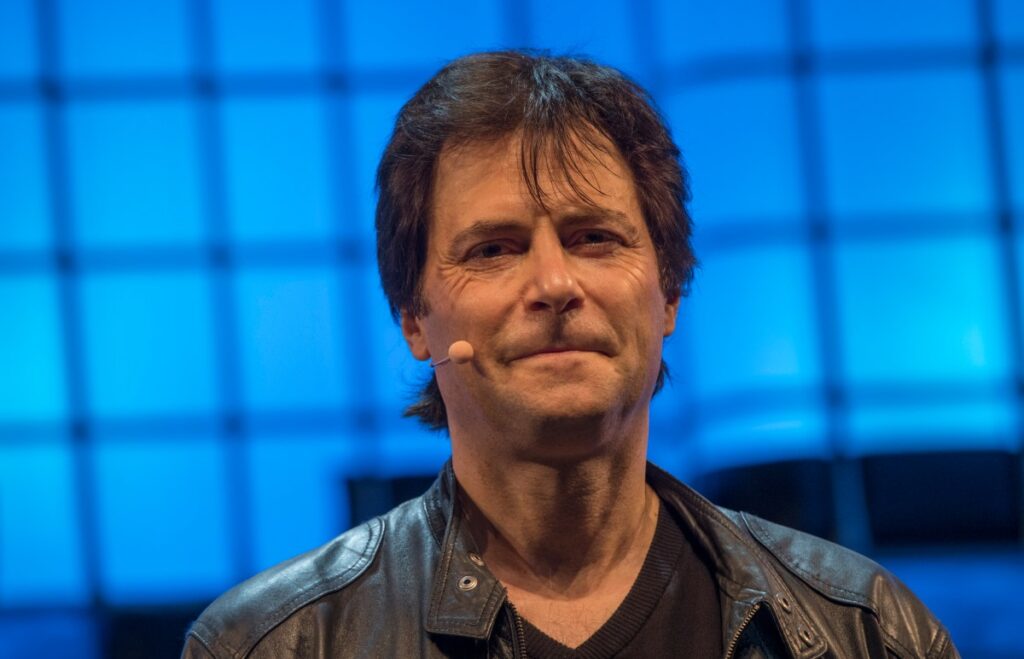

« Quelque chose d’assez remarquable s’est produit en Amérique au cours des quatre derniers mois seulement », a déclaré Max Tegmark, physicien du MIT et chercheur en IA qui a aidé à organiser cet effort, lors d’une conversation avec cet éditeur. « Les sondages montrent soudainement que 95 % de tous les Américains s’opposent à une course non réglementée à la superintelligence. »

Le document récemment publié, signé par des centaines d’experts, d’anciens responsables et de personnalités publiques, s’ouvre sur l’observation pragmatique que l’humanité est à la croisée des chemins. Une voie, que la déclaration appelle « la course au remplacement », conduit à la supplantation des humains d’abord en tant que travailleurs, puis en tant que décideurs, à mesure que le pouvoir augmente au profit d’institutions irresponsables et de leurs machines. L’autre conduit à l’IA qui accroît massivement le potentiel humain.

Ce dernier scénario repose sur cinq piliers clés : garder les humains aux commandes, éviter la concentration du pouvoir, protéger l’expérience humaine, préserver la liberté individuelle et tenir les entreprises d’IA responsables légalement. Parmi ses dispositions les plus musclées figure une interdiction pure et simple du développement de la superintelligence jusqu’à ce qu’il y ait un consensus scientifique sur le fait que cela peut être fait en toute sécurité et une véritable adhésion démocratique ; interrupteurs d’arrêt obligatoires sur les systèmes puissants ; et une interdiction des architectures capables d’auto-réplication, d’auto-amélioration autonome ou de résistance à l’arrêt.

La publication de la déclaration coïncide avec une période qui rend son urgence bien plus facile à apprécier. Le dernier vendredi de février, le secrétaire à la Défense Pete Hegseth a désigné Anthropic – dont l’IA fonctionne déjà sur des plates-formes militaires classifiées – comme un « risque lié à la chaîne d’approvisionnement » après que l’entreprise a refusé d’accorder au Pentagone une utilisation illimitée de sa technologie, un label habituellement réservé aux entreprises ayant des liens avec la Chine. Quelques heures plus tard, OpenAI a conclu son propre accord avec le ministère de la Défense, un accord qui, selon les experts juridiques, sera difficile à appliquer de manière significative. Ce qui est tout à fait désolant, c’est à quel point l’inaction du Congrès en matière d’IA est devenue coûteuse.

Comme Dean Ball, chercheur principal à la Foundation for American Innovation, l’a déclaré au New York Times par la suite : « Il ne s’agit pas simplement d’un différend sur un contrat. C’est la première conversation que nous avons eue en tant que pays sur le contrôle des systèmes d’IA ».

Événement Techcrunch

San Francisco, Californie

|

13-15 octobre 2026

Tegmark a recherché une analogie que la plupart des gens peuvent comprendre lorsque nous avons parlé. « Vous n’avez jamais à craindre qu’une société pharmaceutique commercialise un autre médicament qui cause des dommages considérables avant que les gens n’aient compris comment le rendre sûr », a-t-il déclaré, « parce que la FDA ne leur permettra pas de commercialiser quoi que ce soit tant qu’il ne sera pas suffisamment sûr. »

Les guerres intestines à Washington génèrent rarement le genre de pression publique susceptible de modifier les lois. Au lieu de cela, Tegmark considère la sécurité des enfants comme le point de pression le plus susceptible de sortir de l’impasse actuelle. En effet, la déclaration appelle à des tests obligatoires avant le déploiement des produits d’IA – en particulier des chatbots et des applications compagnons destinées aux jeunes utilisateurs – couvrant les risques, notamment l’augmentation des idées suicidaires, l’exacerbation des problèmes de santé mentale et la manipulation émotionnelle.

« Si un vieil homme effrayant envoie un message à un enfant de 11 ans en se faisant passer pour une jeune fille et essaie de persuader ce garçon de se suicider, ce type peut aller en prison pour cela », a déclaré Tegmark. « Nous avons déjà des lois. C’est illégal. Alors pourquoi est-ce différent si une machine le fait ? »

Il estime qu’une fois établi le principe des tests préalables à la commercialisation des produits pour enfants, le champ d’application s’élargira presque inévitablement. « Les gens viendront et diront : ajoutons quelques autres exigences. Peut-être devrions-nous également vérifier que cela ne peut pas aider les terroristes à fabriquer des armes biologiques. Peut-être devrions-nous tester pour nous assurer que la superintelligence n’a pas la capacité de renverser le gouvernement américain. »

Ce n’est pas rien que l’ancien conseiller de Trump, Steve Bannon, et Susan Rice, conseillère à la sécurité nationale du président Obama, aient signé le même document – aux côtés de l’ancien président des Joint Chiefs Mike Mullen et de chefs religieux progressistes.

« Ce sur quoi ils sont bien sûr d’accord, c’est qu’ils sont tous humains », explique Tegmark. « S’il s’agit de savoir si nous voulons un avenir pour les humains ou un avenir pour les machines, bien sûr, ils seront du même côté. »