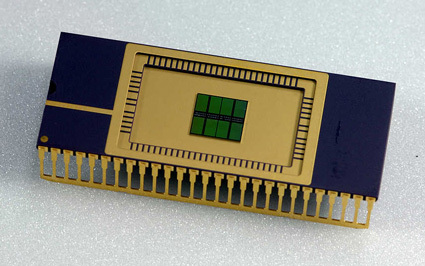

Lorsque nous parlons du coût de l’infrastructure d’IA, l’accent est généralement mis sur Nvidia et les GPU, mais la mémoire joue un rôle de plus en plus important. Alors que les hyperscalers se préparent à construire de nouveaux centres de données valant des milliards de dollars, le prix des puces DRAM a été multiplié par environ 7 au cours de la dernière année.

Dans le même temps, il existe une discipline croissante dans l’orchestration de toute cette mémoire pour garantir que les bonnes données parviennent au bon agent au bon moment. Les entreprises qui le maîtrisent pourront effectuer les mêmes requêtes avec moins de jetons, ce qui peut faire la différence entre se retirer et rester en activité.

L’analyste des semi-conducteurs Doug O’Laughlin a un regard intéressant sur l’importance des puces mémoire sur son Substack, où il s’entretient avec Val Bercovici, directeur de l’IA chez Weka. Ce sont tous deux des spécialistes des semi-conducteurs, donc l’accent est davantage mis sur les puces que sur l’architecture plus large ; les implications pour les logiciels d’IA sont également assez importantes.

J’ai été particulièrement frappé par ce passage, dans lequel Bercovici examine la complexité croissante de la documentation de mise en cache d’invite d’Anthropic :

Le problème est que nous allons sur la page de tarification de la mise en cache rapide d’Anthropic. Cela a commencé comme une page très simple il y a six ou sept mois, surtout au moment du lancement de Claude Code : il suffit de « utilisez la mise en cache, c’est moins cher ». Il s’agit désormais d’une encyclopédie de conseils sur le nombre exact d’écritures de cache à pré-acheter. Vous disposez de niveaux de 5 minutes, très courants dans le secteur, ou de niveaux d’une heure, et rien de plus. C’est un message vraiment important. Bien sûr, vous disposez de toutes sortes d’opportunités d’arbitrage autour de la tarification des lectures de cache en fonction du nombre d’écritures de cache que vous avez pré-achetées.

La question ici est de savoir combien de temps Claude conserve votre invite dans la mémoire cache : vous pouvez payer pour une fenêtre de 5 minutes, ou payer plus pour une fenêtre d’une heure. Il est beaucoup moins coûteux d’exploiter des données qui sont encore dans le cache, donc si vous les gérez correctement, vous pouvez économiser énormément. Il y a cependant un problème : chaque nouveau bit de données que vous ajoutez à la requête peut faire sortir quelque chose d’autre de la fenêtre du cache.

C’est une tâche complexe, mais le résultat est assez simple : la gestion de la mémoire dans les modèles d’IA constituera une partie importante de l’IA à l’avenir. Les entreprises qui le font bien vont se hisser au sommet.

Et de nombreux progrès restent à faire dans ce nouveau domaine. En octobre, j’ai couvert une startup appelée Tensormesh qui travaillait sur une couche de la pile connue sous le nom d’optimisation du cache.

Événement Techcrunch

Boston, Massachusetts

|

23 juin 2026

Des opportunités existent dans d’autres parties de la pile. Par exemple, plus bas dans la pile, se pose la question de savoir comment les centres de données utilisent les différents types de mémoire dont ils disposent. (L’interview comprend une discussion intéressante sur le moment où les puces DRAM sont utilisées à la place du HBM, même si cela est assez profond dans les mauvaises herbes matérielles.) Plus haut dans la pile, les utilisateurs finaux découvrent comment structurer leurs essaims de modèles pour tirer parti du cache partagé.

À mesure que les entreprises améliorent leur orchestration de la mémoire, elles utiliseront moins de jetons et l’inférence deviendra moins chère. Pendant ce temps, les modèles deviennent plus efficaces dans le traitement de chaque jeton, ce qui réduit encore davantage les coûts. À mesure que les coûts des serveurs baissent, de nombreuses applications qui ne semblent pas viables actuellement commenceront à devenir rentables.