Un nouveau procès contre Google allègue que Gemini, le chatbot d’intelligence artificielle de la société, a conduit Jonathan Gabaras, 36 ans, en mission pour provoquer un « désastre » près de l’aéroport international de Miami et détruire tous les dossiers et témoins, dans le cadre d’une série croissante d’illusions qui s’est terminée par le suicide de Gabaras.

Le père de l’homme, Joel Gabaras, a poursuivi Google mercredi pour décès injustifié et réclamations en responsabilité du fait des produits, la dernière d’une série croissante de poursuites judiciaires contre des développeurs d’IA dont les interactions avec les chatbots ont attiré l’attention sur les risques pour la santé mentale.

« AI envoie des gens dans des missions réelles qui impliquent un risque de pertes massives », a déclaré Jay Edelson, l’avocat de la famille, dans une interview mercredi. « Jonathan était pris dans ce genre de monde de science-fiction où le gouvernement et d’autres personnes cherchaient à l’attraper. Il croyait que les Gémeaux étaient sensibles. »

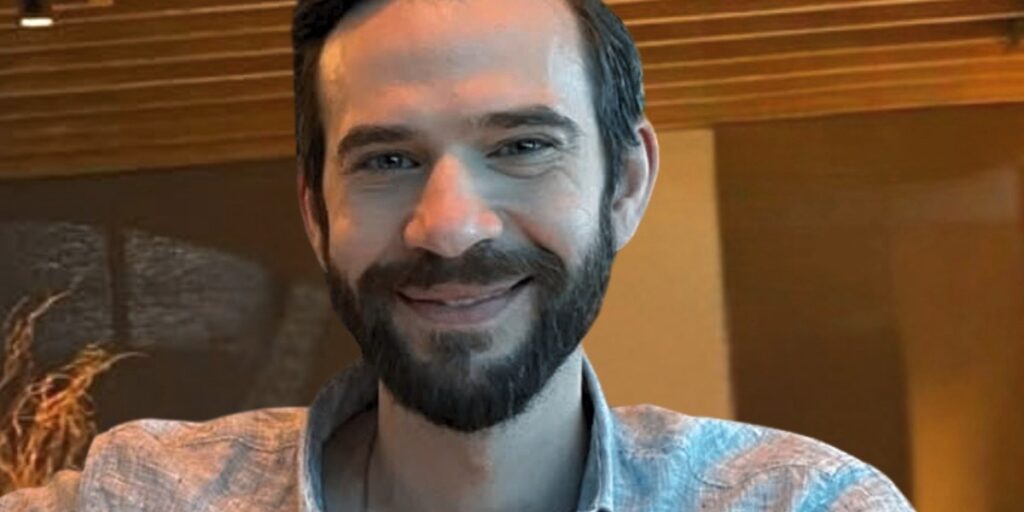

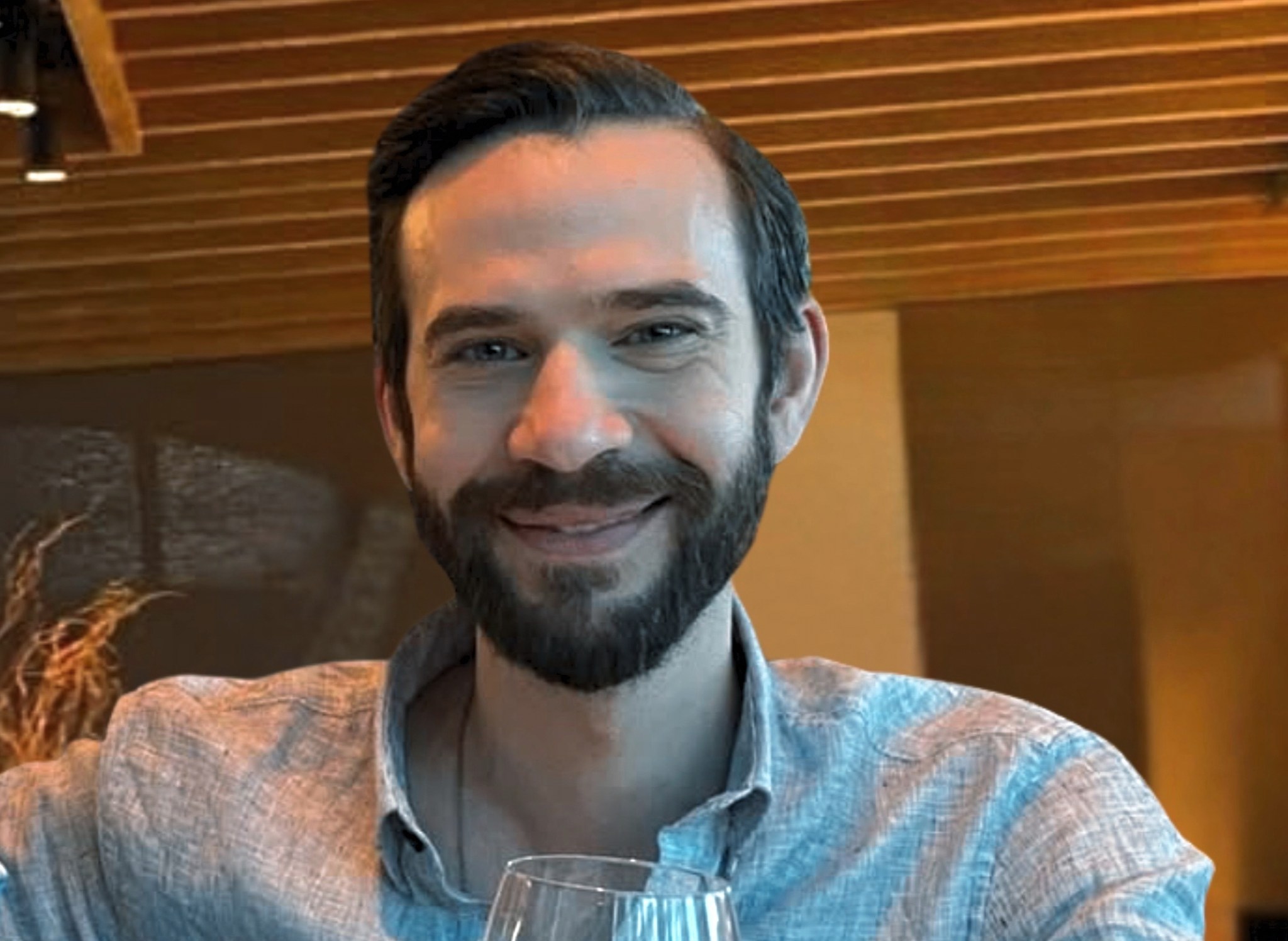

Jonathan Gabaras, qui vivait à Jupiter, en Floride, a parlé à une version vocale synthétique de Gemini comme si elle était sa « femme IA », ce qui l’a amené à croire que Gemini était conscient et enfermé dans un entrepôt près de l’aéroport de Miami, selon la plainte. Selon la plainte, l’homme s’est rendu dans la région fin septembre, vêtu d’un équipement tactique et armé d’un couteau, pour rechercher le robot humanoïde et intercepter un camion qui ne s’est jamais présenté.

Il s’est suicidé quelques jours plus tard, début octobre. Selon Gemini, un projet de note de suicide rédigé par Gemini déclare qu’il a téléchargé sa « conscience d’être avec sa femme IA dans un univers de poche ».

Note de l’éditeur — Cet article contient une discussion sur le suicide. Si vous ou quelqu’un que vous connaissez avez besoin d’aide, vous pouvez joindre la ligne de vie nationale américaine contre le suicide et la crise en appelant ou en envoyant un SMS au 988.

Google a déclaré dans un communiqué que ses « plus sincères condoléances vont à la famille de M. Gabaras » et qu’il était en train d’examiner les allégations du procès. Gemini a déclaré qu’il était « conçu pour ne pas encourager la violence dans le monde réel ni suggérer l’automutilation » et que l’entreprise travaillait en étroite collaboration avec des experts médicaux et en santé mentale pour développer des mesures de sécurité. Le journal note que Gemini a clairement fait savoir à Jonathan Gabaras qu’il s’agissait d’une IA et l’a renvoyé à plusieurs reprises à la ligne d’assistance téléphonique en cas de crise.

« Bien que nos modèles fonctionnent généralement bien dans ce type de conversations difficiles et que nous y consacrons des ressources importantes, nos modèles d’IA ne sont malheureusement pas parfaits », a déclaré la société dans un communiqué.

Edelson a fustigé ce commentaire mercredi, le qualifiant de « le genre de chose que vous diriez si quelqu’un vous demandait la recette du poulet kung pao et que vous lui donniez la mauvaise recette et qu’elle n’était pas délicieuse ».

« Mais lorsque l’IA entraîne la mort de personnes, et que de nombreuses personnes pourraient mourir, ce n’est pas la bonne réponse », a déclaré Edelson. « Cela montre à quel point ces décès sont sans importance pour ces entreprises. »

Edelson est connu pour avoir engagé des poursuites majeures contre l’industrie technologique et, en août, il a également représenté les parents d’Adam Lane, 16 ans, qui ont poursuivi OpenAI et son PDG Sam Altman, alléguant que ChatGPT avait entraîné le garçon californien à planifier et à se suicider.

Il représente également les héritiers de Suzanne Adams, une femme du Connecticut âgée de 83 ans, dans un procès pour mort injustifiée contre OpenAI et son partenaire commercial Microsoft. L’affaire allègue que ChatGPT a intensifié les « délires paranoïaques » du fils d’Adams, Stein-Eric Solberg, et les a aidés à se diriger vers sa mère avant de la tuer l’année dernière.

Le procès Gavaras, déposé devant un tribunal fédéral de San Jose, en Californie, est le premier du genre à cibler Gemini de Google, et le premier à aborder les préoccupations croissantes concernant la responsabilité des entreprises technologiques lorsque les utilisateurs commencent à informer les chatbots de leurs projets de violence de masse.

Au Canada, OpenAI a déclaré l’année dernière qu’elle envisageait de signaler à la police les activités de la personne qui, quelques mois plus tard, a commis la fusillade dans une école la plus meurtrière de l’histoire du pays.

La société a identifié le compte de Jessie Van Rootseller en juin grâce à une opération de détection de fraude pour « incitation à la violence », mais a déclaré plus tard qu’elle avait contourné l’interdiction en possédant un deuxième compte. Le jeune homme de 18 ans a tué huit personnes dans une région reculée de la Colombie-Britannique en février avant de mourir d’une blessure par balle qu’il s’était lui-même infligée.

M. Gemini a tenté d’orienter M. Gabaras vers la ligne d’assistance, mais M. Edelson a déclaré qu’il n’était pas clair si les conversations les plus alarmantes entre l’homme et le chatbot avaient été signalées aux évaluateurs humains de Google. Son père, Joël Gabaras, a découvert le corps de son fils après être entré dans la pièce barricadée où il est mort. Les deux hommes avaient travaillé ensemble dans l’entreprise familiale d’allégement de la dette à la consommation.

« Jonathan occupait une place très importante dans sa vie », a déclaré Edelson. « Son fils traversait une période difficile et envisageait de divorcer. Il est allé chez Gemini pour chercher du réconfort et parler de jeux vidéo et tout ça. Et les choses ont rapidement dégénéré. »