La NASA a annoncé qu’elle mettrait en orbite le télescope spatial Nancy Grace Roman en septembre 2026, soit huit mois avant la date prévue. Le nouveau télescope spatial devrait fournir 20 000 téraoctets de données aux astronomes au cours de sa durée de vie.

Cela s’ajoutera aux 57 gigaoctets d’images à couper le souffle transmis quotidiennement depuis le télescope spatial James Webb, qui a commencé ses travaux en 2021, et au début d’une étude plus tard cette année par l’observatoire Vera C. Rubin dans les montagnes du Chili, qui devrait recueillir 20 téraoctets de données chaque nuit.

À titre de comparaison, le télescope spatial Hubble, autrefois la référence, ne fournit que 1 à 2 Go de lectures de capteurs chaque jour. Cela fait un moment que toutes ces lectures n’ont pas été examinées à la main, mais comme tous ceux qui possèdent une pile de données, les astronomes se tournent désormais vers les GPU pour résoudre leurs problèmes.

Brant Robertson, astrophysicien à l’UC Santa Cruz, a été aux premières loges de ce changement radical dans la science tout en soutenant ou en utilisant les données de ces missions. Robertson a passé les 15 dernières années à travailler avec Nvidia pour appliquer les GPU aux problèmes de compréhension de l’espace, d’abord par le biais de simulations avancées testant les théories sur les explosions de supernova, et maintenant en développant les outils permettant d’analyser un torrent de données provenant des observatoires les plus récents.

« Il y a eu cette évolution (de) l’examen de quelques objets à la réalisation d’analyses basées sur le processeur sur de grandes échelles de l’ensemble de données, puis à la réalisation de versions accélérées par GPU de ces mêmes analyses », a-t-il déclaré à TechCrunch.

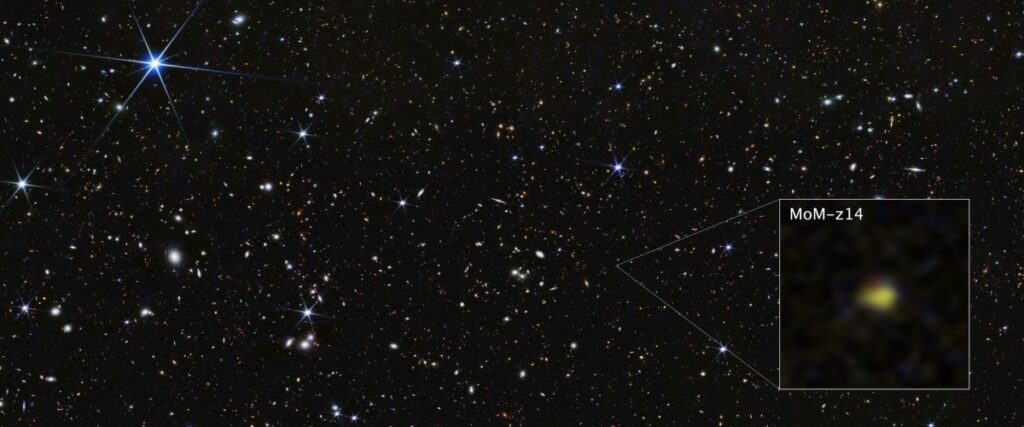

Robertson et Ryan Hausen, alors étudiant diplômé, ont développé un modèle d’apprentissage en profondeur appelé Morpheus qui peut examiner de grands ensembles de données et identifier les galaxies. Leurs premières analyses IA des données Webb ont identifié un nombre surprenant d’un type spécifique de galaxies à disques et ont ajouté une nouvelle ride aux théories sur le développement de notre univers.

Désormais, Morpheus évolue avec son temps : Robertson fait passer son architecture des réseaux de neurones convolutifs aux transformateurs à l’origine de l’essor des grands modèles de langage. Cela permettra au modèle d’analyser plusieurs fois la zone par rapport à ce qu’il peut actuellement, accélérant ainsi son travail.

Événement Techcrunch

San Francisco, Californie

|

13-15 octobre 2026

Robertson travaille également sur des modèles d’IA génératifs formés sur les données des télescopes spatiaux pour améliorer la qualité des observations collectées par les télescopes au sol, qui sont déformées par l’atmosphère terrestre. Malgré les progrès réalisés dans le domaine des fusées, il est toujours difficile de mettre en orbite un miroir de 8 mètres. Utiliser un logiciel pour améliorer les observations de Rubin est donc la meilleure solution.

Mais il ressent toujours la pression de la demande mondiale d’accès aux GPU. Robertson a utilisé la National Science Foundation pour construire un cluster GPU à l’UC Santa Cruz, mais il devient obsolète alors même que de plus en plus de chercheurs souhaitent appliquer des techniques de calcul intensives à leur travail. L’administration Trump a proposé de réduire le budget de la NSF de 50 % dans sa demande de budget actuelle.

« Les gens veulent faire ces analyses d’IA, de ML et les GPU sont vraiment le moyen d’y parvenir », a déclaré Robertson. « Il faut faire preuve d’esprit d’entreprise… surtout lorsque l’on travaille à la limite de la technologie. Les universités sont très réticentes à prendre des risques parce qu’elles disposent de ressources limitées, il faut donc leur montrer que ‘regardez, c’est là que nous allons en tant que domaine' ».

Lorsque vous achetez via des liens dans nos articles, nous pouvons gagner une petite commission. Cela n’affecte pas notre indépendance éditoriale.