LAS VEGAS, 2 décembre : L’unité de cloud computing AWS d’Amazon.com a annoncé mardi qu’elle inclurait les technologies clés de Nvidia dans les futures générations de ses puces informatiques d’intelligence artificielle, alors que la société intensifie ses efforts pour inciter les principaux clients de l’IA à utiliser ses services.

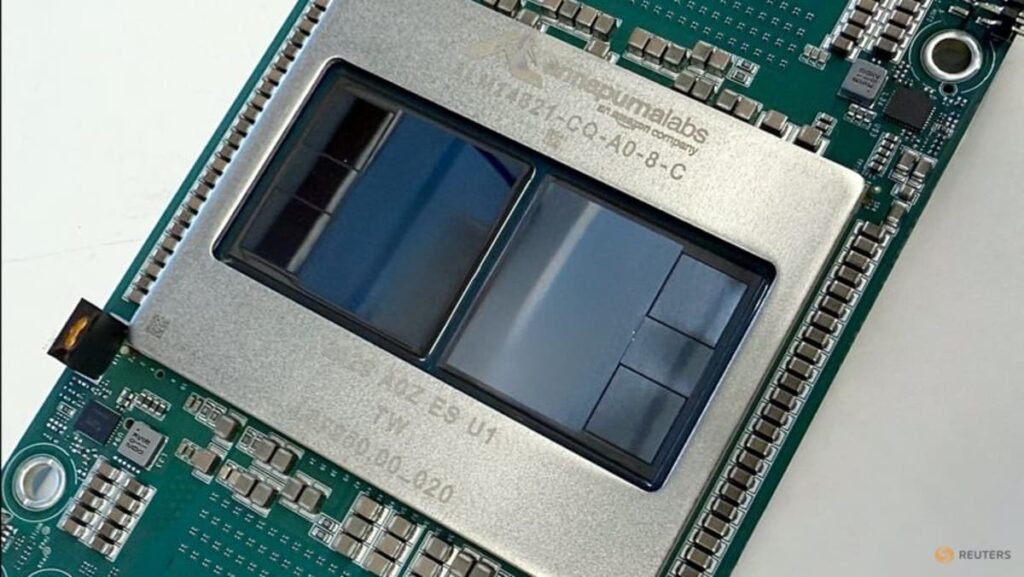

AWS (Amazon Web Services) a annoncé que sa future puce, baptisée Trainium4, embarquera une technologie baptisée NVLink Fusion. La date de sortie n’a pas été divulguée. La technologie NVLink permet des connexions à haut débit entre différents types de puces et constitue l’un des joyaux de Nvidia.

Les sociétés ont fait cette annonce dans le cadre de la conférence annuelle d’une semaine sur le cloud computing d’AWS, qui attire environ 60 000 personnes à Las Vegas.

Nvidia conclut des accords avec d’autres sociétés de puces pour adopter sa technologie NVLink, avec la participation d’Intel, de Qualcomm et désormais d’AWS.

Cette technologie aide AWS à créer des serveurs d’IA à grande échelle capables de se reconnaître et de communiquer rapidement entre eux. Il s’agit d’un facteur clé lors de la formation de modèles d’IA à grande échelle qui nécessitent d’assembler des milliers de machines. Dans le cadre du partenariat Nvidia, les clients auront accès à ce qu’AWS appelle AI Factory, une infrastructure d’IA dédiée au sein de ses propres centres de données pour augmenter la vitesse et la réactivité.

« Ensemble, Nvidia et AWS construisent la structure informatique pour la révolution industrielle de l’IA, en apportant l’IA avancée à chaque entreprise dans chaque pays et en accélérant la voie vers l’intelligence mondiale », a déclaré le PDG de Nvidia, Jensen Huang, dans un communiqué.

Par ailleurs, Amazon a annoncé le déploiement de nouveaux serveurs basés sur une puce appelée Trainium3. Les nouveaux serveurs lancés mardi disposent chacun de 144 puces et ont une puissance de calcul plus de quatre fois supérieure et consomment 40 % d’énergie en moins que la génération précédente d’IA d’AWS, a déclaré à Reuters Dave Brown, vice-président des services de calcul et d’apprentissage automatique d’AWS.

Brown n’a pas fourni de chiffres absolus sur les capacités ou les performances, mais a déclaré qu’AWS visait à rivaliser avec ses concurrents, dont Nvidia, sur la base du prix.

« Nous devons leur prouver que nous disposons d’un produit qui offre les performances dont ils ont besoin et qui est au bon prix afin qu’ils puissent bénéficier de ce rapport qualité-prix », a déclaré Brown. « Pour qu’ils puissent dire : ‘Oh ouais, c’est la puce que je veux utiliser.' »

La société a également annoncé mardi une nouvelle version de son modèle d’IA connue sous le nom de Nova. Amazon affirme que Nova 2 est plus rapide et plus réactif et comprend une version appelée Nova qui peut répondre avec des images, du texte en texte et des invites d’image, audio et vidéo. Un autre robot, appelé Sonic, peut répondre aux invites vocales avec une sortie vocale, que le PDG d’AWS, Matt Garman, a qualifié de « semblable à un humain » dans son discours.

Amazon a eu du mal à faire accepter Nova par rapport à des concurrents tels que ChatGPT d’OpenAI, Claude d’Anthropic et Gemini de Google. Pourtant, Amazon a vu ses revenus AWS augmenter de 20 % au cours du dernier trimestre, en grande partie grâce à ses services de cloud computing et d’infrastructure d’IA.

Lors de la conférence AWS de Las Vegas, Amazon a également présenté un service appelé Nova Forge qui permet aux entreprises de créer leurs propres modèles d’IA à l’aide des données saisies. « Cela nous permet de créer des modèles qui comprennent en profondeur les informations sans oublier les informations de base qui y ont été formées », a déclaré Garman.

L’action Amazon a augmenté de 0,9% à 235,98 $ mardi midi.