Amazon vient de réussir un coup majeur avec Meta grâce, une fois de plus, aux propres puces d’Amazon. Meta a signé un accord pour utiliser des millions de puces AWS Graviton pour répondre à ses besoins croissants en IA, a annoncé Amazon vendredi.

Notez que AWS Graviton est un processeur basé sur ARM (une unité centrale de traitement, la puce qui gère les tâches informatiques générales) et non un GPU (une unité de traitement graphique).

Même si les GPU restent la puce de choix pour l’entraînement de grands modèles, une fois ces modèles entraînés, les agents d’IA construits dessus provoquent un changement dans le type de puce nécessaire. Les agents créent des charges de travail gourmandes en calcul, telles que le raisonnement en temps réel, l’écriture de code, la recherche et la coordination impliquée dans la gestion des agents via des tâches en plusieurs étapes. La dernière version d’AWS de Graviton a été spécialement conçue pour répondre aux besoins de calcul liés à l’IA, indique la société.

Cet accord rapporte une plus grande part de l’argent de Meta à AWS plutôt qu’à des concurrents comme Google Cloud. En août dernier, Meta a signé un accord de 10 milliards de dollars sur six ans avec Google Cloud, même si Meta était jusque-là principalement un client AWS qui utilisait également Microsoft Azure.

Nous n’avons pas pu nous empêcher de remarquer qu’AWS a programmé l’annonce de cet accord juste au moment où la conférence Google Cloud Next se terminait, comme un sourire narquois virtuel envers son rival du cloud. Bien entendu, Google fabrique également ses propres puces IA personnalisées et en a annoncé de nouvelles versions lors du salon.

Certes, Amazon fabrique également son propre GPU IA : le Trainium, qui, malgré son nom, est utilisé à la fois pour la formation et l’inférence – l’étape qui se produit après la formation d’un modèle, lorsqu’il traite activement les invites.

Mais Anthropic était déjà intervenu avec un accord annoncé plus tôt ce mois-ci qui commandait bon nombre de ces puces pour les années à venir. Le fabricant de Claude a accepté de dépenser 100 milliards de dollars sur 10 ans pour exécuter ses charges de travail sur AWS – avec un accent particulier sur Trainium – tandis qu’Amazon a accepté d’investir 5 milliards de dollars supplémentaires (ce qui porte son total à 13 milliards de dollars d’investissement) dans Anthropic en retour.

Événement Techcrunch

San Francisco, Californie

|

13-15 octobre 2026

En fin de compte, l’accord Meta permet à Amazon de présenter un énorme client d’IA comme point de preuve de ses processeurs locaux. Ce sont des puces qui concurrencent le nouveau processeur Vera de Nvidia, également basé sur ARM et conçu pour gérer les charges de travail agentiques de l’IA. La différence, bien sûr, est que Nvidia vend ses puces et ses systèmes d’IA aux entreprises et aux fournisseurs de cloud (dont AWS). AWS ne vend l’accès à ses puces que via son service cloud.

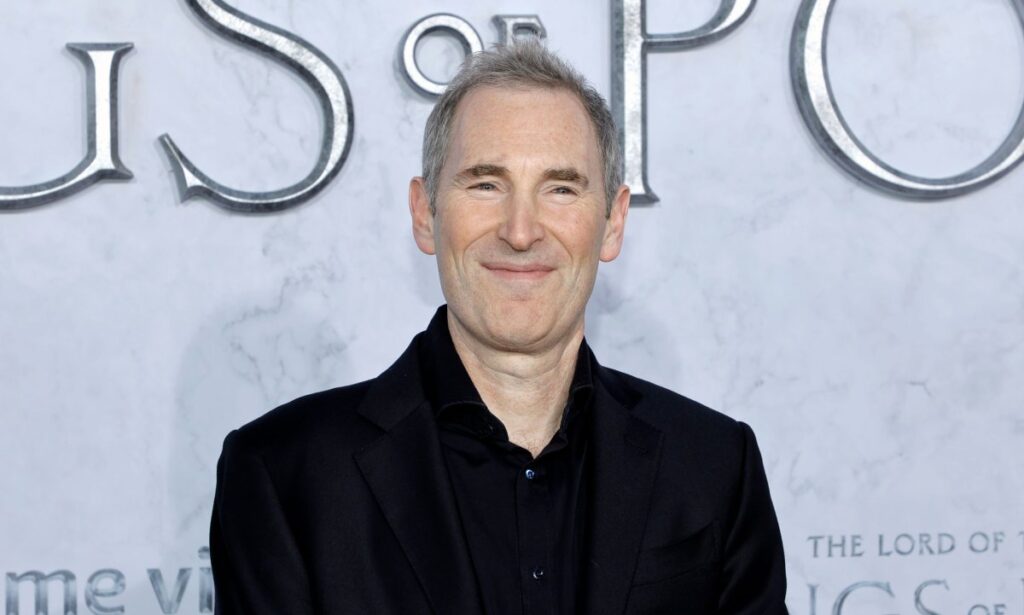

Plus tôt ce mois-ci, le PDG d’Amazon, Andy Jassy, a visé Nvidia et Intel dans sa lettre annuelle aux actionnaires, affirmant que les entreprises souhaitaient de meilleurs rapports prix-performance pour l’IA et qu’il avait l’intention de remporter des contrats sur cette base. Cela signifie également que la pression ne pourrait pas être plus forte sur l’équipe interne de construction de puces d’Amazon, une équipe que nous avons visitée le mois dernier lors d’une visite exclusive de leur laboratoire.

Lorsque vous achetez via des liens dans nos articles, nous pouvons gagner une petite commission. Cela n’affecte pas notre indépendance éditoriale.